Интернет магазин китайских планшетных компьютеров |

|

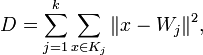

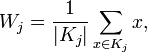

Компьютеры - Нейронная сеть Кохонена - Сети векторного квантования23 января 2011Оглавление: 1. Нейронная сеть Кохонена 2. Сети векторного квантования 3. Самоорганизующиеся карты Кохонена 4. Упругие карты 5. Сети векторного квантования, обучаемые с учителем Задача векторного квантования с k кодовыми векторами Wj для заданной совокупности входных векторов S ставится как задача минимизации искажения при кодировании, то есть при замещении каждого вектора из S соответствующим кодовым вектором. В базовом варианте сетей Кохонена используется метод наименьших квадратов и искажение D вычисляется по формуле где Kj состоит из тех точек Если совокупность S задана и хранится в памяти, то стандартным выбором в обучении соответствующей сети Кохонена является метод K-средних. Это метод расщепления:

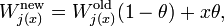

где | Kj | — число элементов в Kj. Далее итерируем. Этот метод расщепления сходится за конечное число шагов и даёт локальный минимум искажения. Если же, например, совокупность S заранее не задана, или по каким-либо причинам не хранится в памяти, то широко используется онлайн метод. Векторы входных сигналов x обрабатываются по одному, для каждого из них находится ближайший кодовый вектор Wj. После этого данный кодовый вектор пересчитывается по формуле где Для обеспечения стабильности используется онлайн метод с затухающей скоростью обучения: если T — количество шагов обучения, то полагают θ = θ. Функцию θ > 0 выбирают таким образом, чтобы Векторное квантование является намного более общей операцией, чем кластеризация, поскольку кластеры должны быть разделены между собой, тогда как совокупности Kj для разных кодовых векторов Wj не обязательно представляют собой раздельные кластеры. С другой стороны, при наличии разделяющихся кластеров векторное квантование может находить их и по-разному кодировать. Просмотров: 6578

|

, которые ближе к Wj, чем к другим Wl. Другими словами, Kj состоит из тех точек

, которые ближе к Wj, чем к другим Wl. Другими словами, Kj состоит из тех точек

— шаг обучения. Остальные кодовые векторы на этом шаге не изменяются.

— шаг обучения. Остальные кодовые векторы на этом шаге не изменяются. монотонно при

монотонно при  и чтобы ряд

и чтобы ряд  расходился, например, θ = θ0 / T.

расходился, например, θ = θ0 / T.